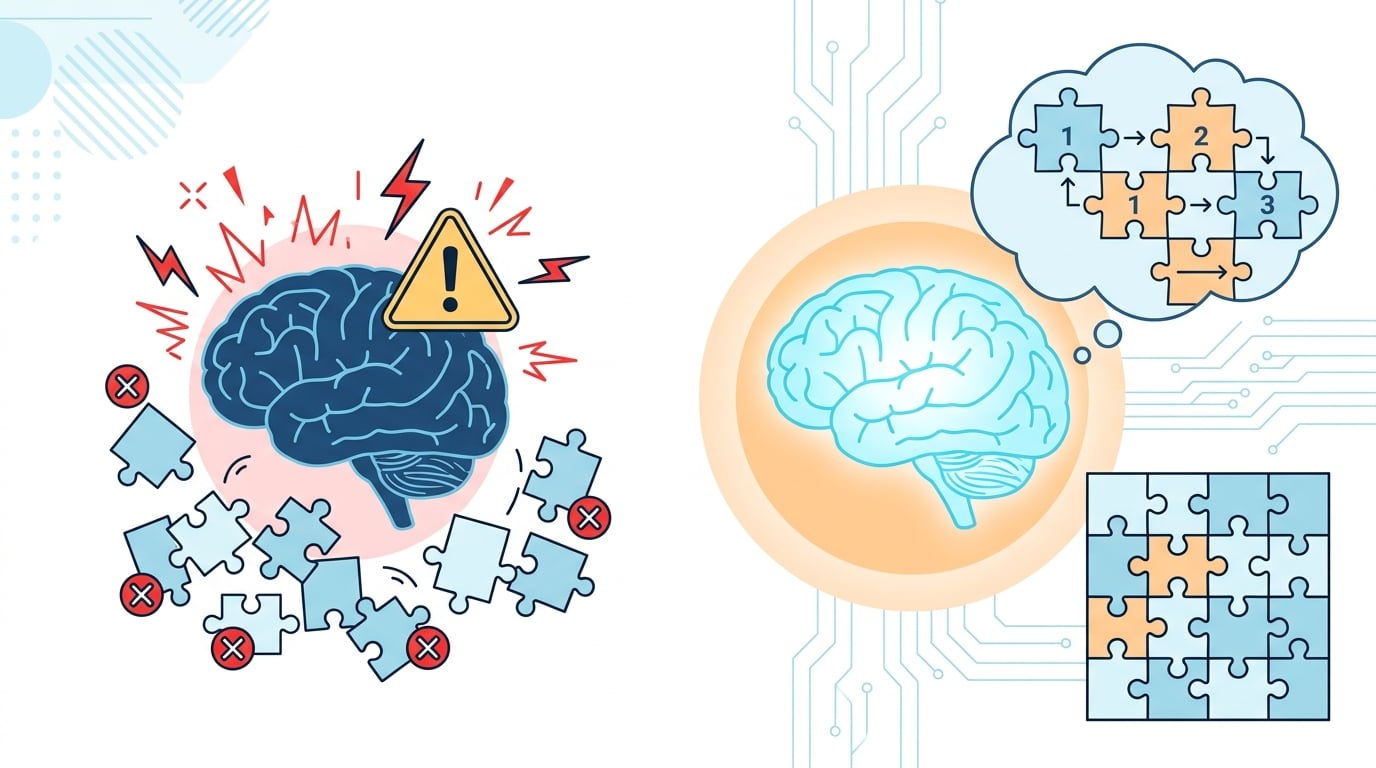

맹목적인 행동의 문제점

복잡한 논리 문제를 해결하거나 여러 정보를 수집할 때, 인공지능에게 즉각적으로 행동을 결정하게 하면 치명적인 오류가 발생할 수 있습니다.

사람이 장난감 조각 퍼즐을 푸는 방식을 생각해 보세요:

- 그들은 단순히 무작위로 조각을 집어보내며 판에 끼우지 않습니다.

- 그들은 정신적 또는 말로 전략을 세웁니다: "먼저 가장자리의 평평한 모서리 조각을 찾아야 하고, 그다음 이 파란색 조각이 맞는지 확인해 볼 거예요."

비슷하게, 만약 우리가 인공지능에게 오직 행동만 출력하도록 유도하고 사고 단계를 건너뛰게 한다면, 그것은 '맹목적으로 행동하는 것'입니다. 질문에 답하기 위한 전제 조건을 명확히 하지 않았기 때문에, 종종 추측하거나 환각을 일으키거나 잘못된 도구를 선택하게 됩니다.

생각을 말로 풀어보기

언어 모델은 토큰 단위로 논리를 구성합니다. 인공지능이 문제를 분석하는 텍스트를 생성하도록 '생각을 말로 풀어보기'를 강제함으로써, 올바른 논리적 결론에 도달할 수 있는 충분한 작업 공간을 제공할 수 있습니다. 선택하기 전에 인공지능이 행동을 선택하기 전에, 올바른 논리적 결론에 도달할 수 있도록 필요한 작업 공간을 제공할 수 있습니다.